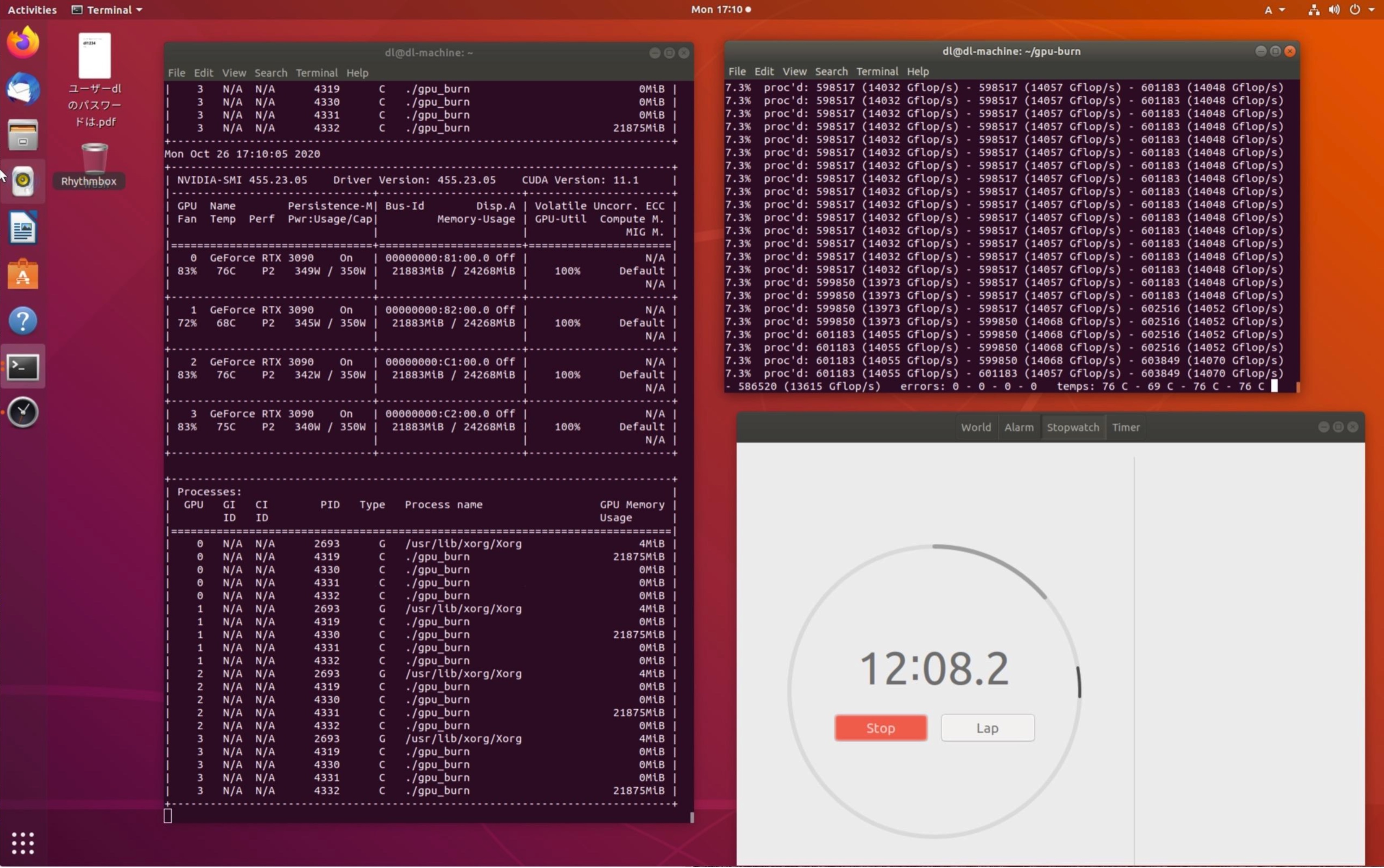

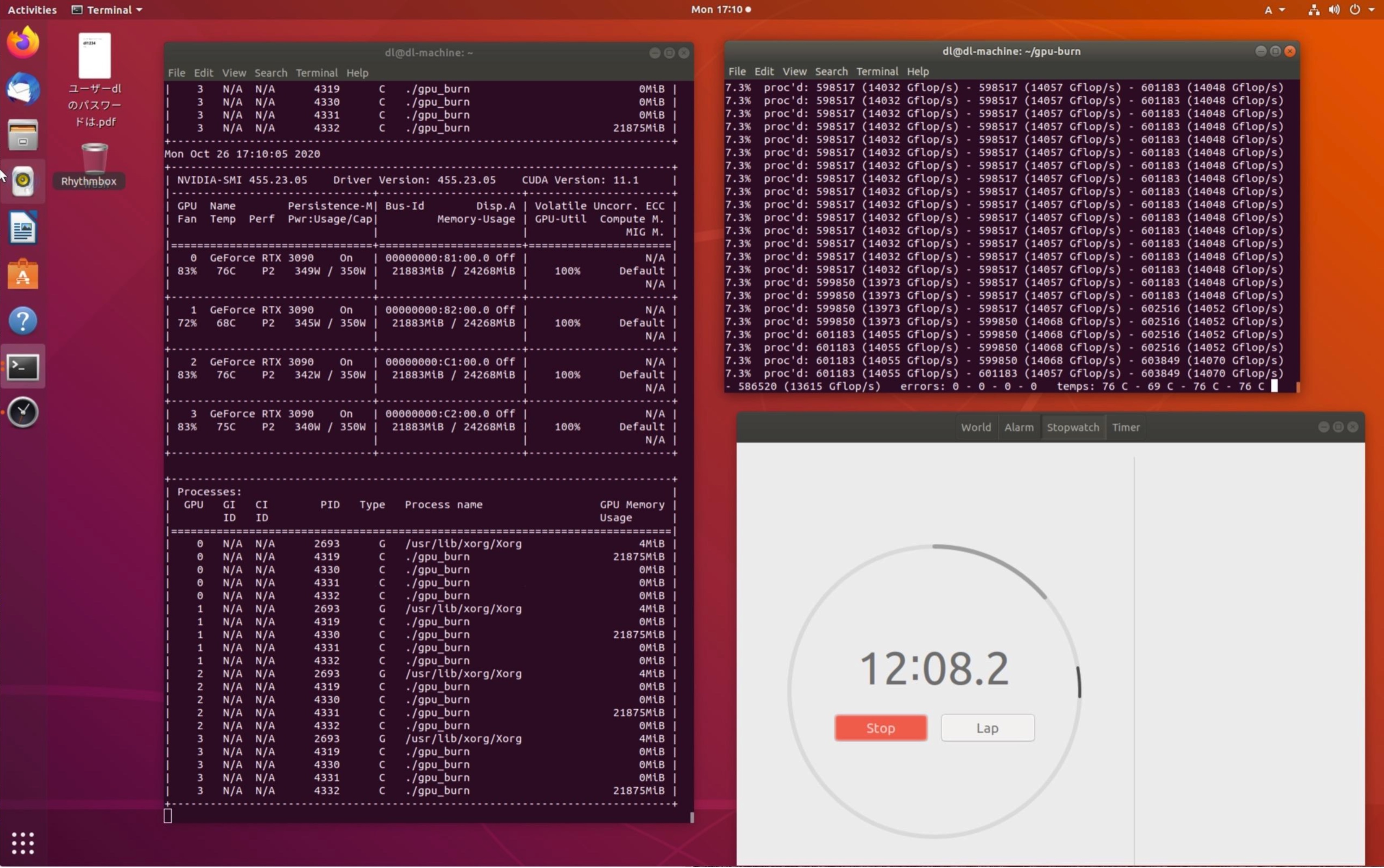

4GPU: HPCDIY-ERM1GPU4TS に RTX3090を4枚実装してGPU100%での消費電力と温度

HPCDIY-ERM1GPU4TS(こちら)にGeForce RTX 3090 を4枚実装し、gpu_burn(こちら)を実行して、消費電力と温度が定常状態になるまでを nvidia-smi -l で監視してみました。

HPCDIY-ERM1GPU4TS(こちら)にGeForce RTX 3090 を4枚実装し、gpu_burn(こちら)を実行して、消費電力と温度が定常状態になるまでを nvidia-smi -l で監視してみました。

消費電力はそれぞれ約350W、温度はMAXで76°Cとまずまずの結果になりました。